修改nginx进行配置

#配置Nginx worker进程最大打开文件数

worker_rlimit_nofile 65535;

#最大连接数数为

worker_connections 20480;

#开启复用连接

keepalive_timeout 65;

gzip on; 压缩传输数据客户端最大连接数优化,这个值默认为1024,这也是ab -c 2000 -n 2000 http://192.168.0.201/报错的原因。修改为65535,一个不可能达到的值。

修改系统限制(内核参数)

修改nginx运行时打开的进程数,这个值和cpu的核数有关,保持和CPU的核数一致。

# lscpu

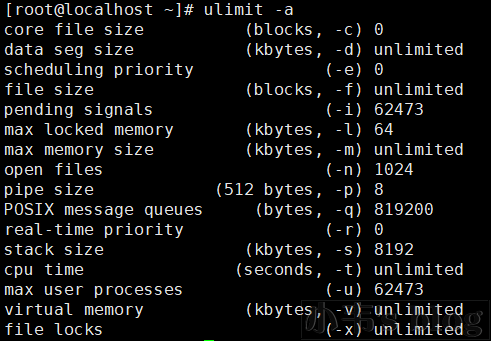

#查看用户系统限制

# ulimit -a

这两个值的修改命令,临时修改,立即生效,无需重启。

# ulimit -Hn 50000 #临时有效,重启后恢复默认值1024

# ulimit -Sn 50000 #临时有效,重启后恢复默认值1024

-H:硬修改,修改后打开文件数不能超过这个数

-S:软修改,修改后打开文件数可以超过这个数

-n:这个上图中50000数值钱那个括号里面的-n

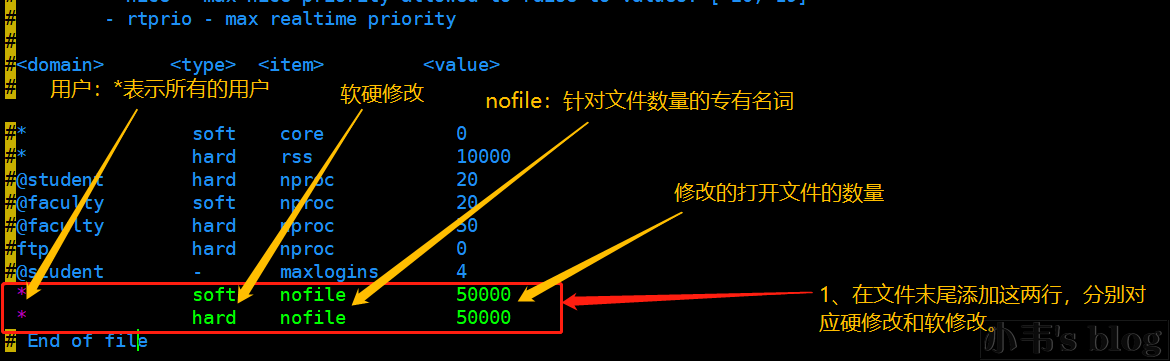

永久修改,重启生效,需重启服务器。

修改配置文件,/etc/security/limits.conf

* soft nproc 62473 #最大进程数 //不是noproc, 是nproc

* hard nproc 62473 #最大进程数

* soft nofile 62473 #最大打开文件数

* hard nofile 62473 #最大打开文件数系统网络修改

# vi /etc/sysctl.conf

# sysctl -p

backlog的值是网络连接过程中,某种状态的队列的长度;如果并发过高,那么会导致backlog的队列占满,服务器就会丢掉传进来的其他连接,然后就会出现客户端连接失败的情形;

//每个网络接口接收数据包的速率比内核处理这些包的速率快时,允许发送到队列的数据包的最大数目

//表示网卡设备的backlog, 因为网卡接收数据包的速度远大于内核处理这些数据包的速度,所以,就出现了网卡设备的backlog.

# cat /proc/sys/net/core/netdev_max_backlog //1000

# echo "4096" > /proc/sys/net/core/netdev_max_backlog

net.core.netdev_max_backlog = 65535

//调节系统同时发起的TCP连接数

# cat /proc/sys/net/core/somaxconn //128

net.core.somaxconn = 65535

//设定系统中最多允许存在多少tcp套接字不被关联到任何一个用户文件句柄上

# cat /proc/sys/net/ipv4/tcp_max_orphans //65535

net.ipv4.tcp_max_orphans = 65535

//记录的那些尚未收到客户端确认信息的连接请求的最大值

//看下系统上默认的SYN队列大小

# cat /proc/sys/net/ipv4/tcp_max_syn_backlog //512

net.ipv4.tcp_max_syn_backlog = 65535

//表示SYN队列的长度,默认为1024,加大队列长度为8192,可以容纳更多等待连接的网络连接数。

net.ipv4.tcp_max_syn_backlog = 8192

//开启TCP连接中TIME-WAIT sockets的快速回收

net.ipv4.tcp_tw_recycle = 0

//允许将TIME-WAIT sockets重新用于新的TCP连接

net.ipv4.tcp_tw_reuse = 0

//当出现SYN等待队列溢出时,禁用cookies来处理

# cat /proc/sys/net/ipv4/tcp_syncookies //1

net.ipv4.tcp_syncookies = 0

//设置内核放弃TCP连接之前向客户端发送SYN+ACK包的数量

net.ipv4.tcp_synack_retries = 1

//该参数的作用与上一个参数类似,设置内核放弃建立连接之前发送SYN包的数量

net.ipv4.tcp_ack_retries = 1

//看下系统上默认的TIME_WAIT队列大小

# cat /proc/sys/net/ipv4/tcp_max_tw_buckets //65535

//对于本端断开的socket连接,TCP保持在FIN-WAIT-2状态的时间(秒)

# cat /proc/sys/net/ipv4/tcp_fin_timeout //60

net.ipv4.tcp_fin_timeout = 20

//5分钟发个激活包,应对移动端, 现在不需要

//Linux控制keepalive有三个参数:保活时间net.ipv4.tcp_keepalive_time、保活时间间隔net.ipv4.tcp_keepalive_intvl、保活探测次数net.ipv4.tcp_keepalive_probes,默认值分别是 7200 秒(2 小时)、75 秒和 9 次探测。如果使用 TCP 自身的 keep-Alive 机制,在 Linux 系统中,最少需要经过 2 小时 + 9*75 秒后断开。譬如我们SSH登录一台服务器后可以看到这个TCP的keepalive时间是2个小时,并且会在2个小时后发送探测包,确认对端是否处于连接状态。

# cat /proc/sys/net/ipv4/tcp_keepalive_time //7200

#net.ipv4.tcp_keepalive_time =1200

//该文件指定了可以分配的文件句柄的最大数目

//查看本机可以使用的最大文件句柄(建议~),不同的机器会根据不同的内存给出不同的数值,是一个建议数值

# cat /proc/sys/fs/file-max //1604036

//fs.file-max = 163840 //不要设定该值, 能否设置65535要看这个值

#/sbin/sysctl

# sysctl -p | 参数(路径+文件) | 描述 | 默认值 | 优化值 |

| /proc/sys/net/core/rmem_default | 默认的TCP数据接收窗口大小(字节)。 | 212992 | 256960 |

| /proc/sys/net/core/rmem_max | 最大的TCP数据接收窗口(字节)。 | 212992 | 513920 |

| /proc/sys/net/core/wmem_default | 默认的TCP数据发送窗口大小(字节)。 | 212992 | 256960 |

| /proc/sys/net/core/wmem_max | 最大的TCP数据发送窗口(字节)。 | 212992 | 513920 |

| /proc/sys/net/core/netdev_max_backlog | 在每个网络接口接收数据包的速率比内核处理这些包的速率快时,允许送到队列的数据包的最大数目。 | 1000 | 2000 |

| /proc/sys/net/core/somaxconn | 定义了系统中每一个端口最大的监听队列的长度,这是个全局的参数。 | 128 | 2048 |

| /proc/sys/net/core/optmem_max | 表示每个套接字所允许的最大缓冲区的大小。 | 20480 | 81920 |

| /proc/sys/net/ipv4/tcp_mem | 确定TCP栈应该如何反映内存使用,每个值的单位都是内存页(通常是4KB)。第一个值是内存使用的下限;第二个值是内存压力模式开始对缓冲区使用应用压力的上限;第三个值是内存使用的上限。在这个层次上可以将报文丢弃,从而减少对内存的使用。对于较大的BDP可以增大这些值(注意,其单位是内存页而不是字节)。 | 94011 125351 188022 | 131072 262144 524288 |

| /proc/sys/net/ipv4/tcp_rmem | 为自动调优定义socket使用的内存。第一个值是为socket接收缓冲区分配的最少字节数;第二个值是默认值(该值会被rmem_default覆盖),缓冲区在系统负载不重的情况下可以增长到这个值;第三个值是接收缓冲区空间的最大字节数(该值会被rmem_max覆盖)。 | 4096 87380 4011232 | 8760 256960 4088000 |

| /proc/sys/net/ipv4/tcp_wmem | 为自动调优定义socket使用的内存。第一个值是为socket发送缓冲区分配的最少字节数;第二个值是默认值(该值会被wmem_default覆盖),缓冲区在系统负载不重的情况下可以增长到这个值;第三个值是发送缓冲区空间的最大字节数(该值会被wmem_max覆盖)。 | 4096 16384 4011232 | 8760 256960 4088000 |

| /proc/sys/net/ipv4/tcp_keepalive_time | TCP发送keepalive探测消息的间隔时间(秒),用于确认TCP连接是否有效。 | 7200 | 1800 |

| /proc/sys/net/ipv4/tcp_keepalive_intvl | 探测消息未获得响应时,重发该消息的间隔时间(秒)。 | 75 | 30 |

| /proc/sys/net/ipv4/tcp_keepalive_probes | 在认定TCP连接失效之前,最多发送多少个keepalive探测消息。 | 9 | 3 |

| /proc/sys/net/ipv4/tcp_sack | 启用有选择的应答(1表示启用),通过有选择地应答乱序接收到的报文来提高性能,让发送者只发送丢失的报文段,(对于广域网通信来说)这个选项应该启用,但是会增加对CPU的占用。 | 1 | 1 |

| /proc/sys/net/ipv4/tcp_fack | 启用转发应答,可以进行有选择应答(SACK)从而减少拥塞情况的发生,这个选项也应该启用。 | 1 | 1 |

| /proc/sys/net/ipv4/tcp_timestamps | TCP时间戳(会在TCP包头增加12个字节),以一种比重发超时更精确的方法(参考RFC 1323)来启用对RTT 的计算,为实现更好的性能应该启用这个选项。 | 1 | 1 |

| /proc/sys/net/ipv4/tcp_window_scaling | 启用RFC 1323定义的window scaling,要支持超过64KB的TCP窗口,必须启用该值(1表示启用),TCP窗口最大至1GB,TCP连接双方都启用时才生效。 | 1 | 1 |

| /proc/sys/net/ipv4/tcp_syncookies | 表示是否打开TCP同步标签(syncookie),内核必须打开了CONFIG_SYN_COOKIES项进行编译,同步标签可以防止一个套接字在有过多试图连接到达时引起过载。 | 1 | 1 |

| /proc/sys/net/ipv4/tcp_tw_reuse | 表示是否允许将处于TIME-WAIT状态的socket(TIME-WAIT的端口)用于新的TCP连接 。 | 0 | 1 |

| /proc/sys/net/ipv4/tcp_tw_recycle | 能够更快地回收TIME-WAIT套接字。 | 0 | 1 |

| /proc/sys/net/ipv4/tcp_fin_timeout | 对于本端断开的socket连接,TCP保持在FIN-WAIT-2状态的时间(秒)。对方可能会断开连接或一直不结束连接或不可预料的进程死亡。 | 60 | 30 |

| /proc/sys/net/ipv4/ip_local_port_range | 表示TCP/UDP协议允许使用的本地端口号 | 32768 61000 | 1024 65000 |

| /proc/sys/net/ipv4/tcp_max_syn_backlog | 对于还未获得对方确认的连接请求,可保存在队列中的最大数目。如果服务器经常出现过载,可以尝试增加这个数字。 | 2048 | 2048 |

| /proc/sys/net/ipv4/tcp_low_latency | 允许TCP/IP栈适应在高吞吐量情况下低延时的情况,这个选项应该禁用。 | 0 | |

| /proc/sys/net/ipv4/tcp_westwood | 启用发送者端的拥塞控制算法,它可以维护对吞吐量的评估,并试图对带宽的整体利用情况进行优化,对于WAN 通信来说应该启用这个选项。 | 0 | |

| /proc/sys/net/ipv4/tcp_bic | 为快速长距离网络启用Binary Increase Congestion,这样可以更好地利用以GB速度进行操作的链接,对于WAN通信应该启用这个选项。 | 1 |